最近几年AI芯片如火如荼,从英伟达上涨的股票可以看出它的热度。

众多芯片中,AI芯片有何独特的地方呢?为什么普通芯片不能和他有同样功能。

AI的强势之一:并行计算

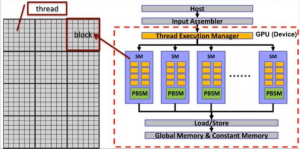

普通CPU只是流水线串行执行,但是AI芯片可以拆解一个大的任务到他们每个小core里执行,像NVIDIA的cuda中概念 <grid,block,thread>。

对于异构的系统,CPU通过下发命令,GPU侧有对应的调度控制器,他可以展开这些命令,并维护进程的syn和上下游通知。

对于软件说有grid→blocks→thread

硬件处理的话GPU会给到SM(streaming Multiprocessor) 之后给到SP(streaming Processor 即cuda core)

比如 GeForce GTX 480这款 其中几个参数为:

Max threads per block:1024

Max thread dimensions:(1024,1024,64)

Max grid dimensions:(65535,65535,65535)

也就是会把一个很大的运算拆成几部分同时运行。

AI的强势之二:高吞吐存储

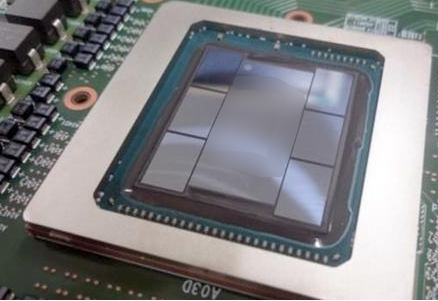

AI两大方向 推理和训练。训练的话需要大量数据,它对数据吞吐就要有很好的掌控。业界首选HBM,因为它区别ddr是它具有3d堆叠技术。然后可以和SOC芯片进行CoWoS封装。以前芯片封装,可以从产品端明显看到一个处理单元,四周布满内存块颗粒,在pcb板上通过布线相连接。而HBM可以和处理单元合封在一颗大的芯片上,隐约从整颗芯片外面只能看到处理芯片和HBM。

pic from 163

AI的强势之三:算力拼接

我们用算力来衡量AI芯片运算能力,不过AI芯片有时候像变形金刚一样,它不仅可以独立自己实现功能,还可以通过片间互联技术,实现多卡协作。

在过去几年里,AI芯片的宣传标准经过多样的变化,比如应对美国制裁的一个指标是单位面积算力,这个从一方面可以限制芯片的实现制程,另一方面也对总的算力上限定了上限。多芯片协作就可以规避此类指标。

通过片间互联可以实现同机台不同芯片,不同机台不同芯片之间共同任务协作。

在优势显著同时,也存在很多技术挑战。不同的AI芯片在架构上、指令集上存在较多差异,编译器也是每个公司针对自己芯片定制。所以产品的研发落地到应用路线较长,也是很多AI企业面临的未知元素。